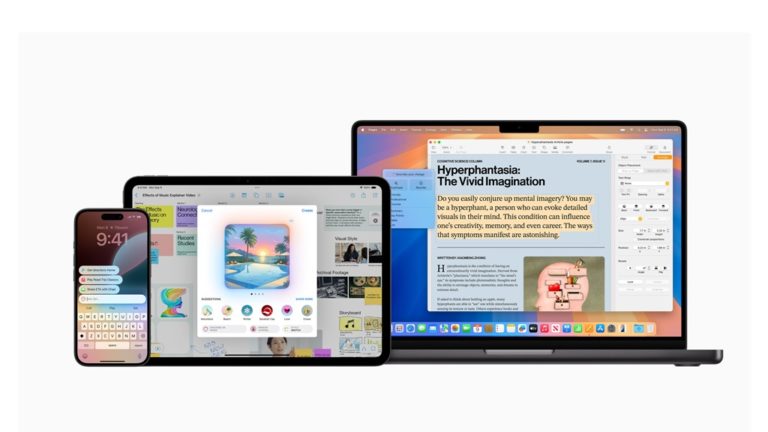

Algunos de los usuarios de dispositivos Apple en español vivimos un gran salto tecnológico la semana pasada. En la pantalla de mi iPhone 15 Pro, por ejemplo, ahora veo destacadas las comunicaciones que son más importantes o urgentes para mí. El asistente Siri ahora trabaja en llave con ChatGPT para responder mis consultas y dudas. Tengo una herramienta de IA que me permite crear imágenes muy divertidas a partir de fotos mías o de mis familiares y amigos. Si quiero saber quién pintó el cuadro que tengo al frente u obtener más datos sobre un restaurante que veo en la calle, puedo obtener la respuesta apuntando la cámara del iPhone a ese elemento o sitio. También puedo grabar llamadas telefónicas y transcribir notas de voz. Y si quiero leer un artículo, pero es demasiado extenso, le puedo pedir a mi iPhone, a mi iPad Pro o a mi Mac Studio que me presenten un resumen del mismo, el cual queda listo en unos pocos segundos.

Esos son algunos de los beneficios de Apple Intelligence, la inteligencia artificial de esa compañía, que finalmente salió en nuestro idioma, luego de que Apple publicara la semana pasada las versiones 18.4 de sus sistemas operativos iOS (el del iPhone), iPadOS (el del iPad) y la versión 15.4 del sistema de los computadores Mac (MacOS Sequioa). Con esas actualizaciones, por primera vez se activaron las características de Apple Intelligence para los iPhone, los iPad y los Mac en español.

Esta es una gran noticia para algunos usuarios de equipos Apple, que ahora cuentan con una IA integrada en el sistema operativo de sus equipos, la cual les permite emplear funciones que facilitan mucho la vida diaria. Pero digo “algunos usuarios” porque no basta con actualizarse a esos nuevos sistemas operativos para poder usar Apple Intelligence: también es necesario contar con un equipo compatible con la IA de Apple.

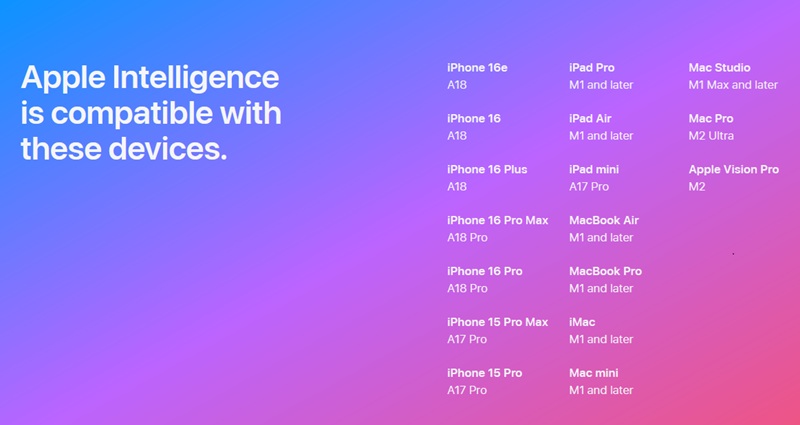

Apple Intelligence solo se puede usar en los modelos Pro del iPhone 15 (lanzados a finales del 2023) y en todos los iPhone 16 (los que se lanzaron a finales del 2024).

En cuanto a los iPad, Apple Intelligence funciona en los tablets de Apple basados en el procesador M1 hacia adelante (y en los iPad Mini con procesador A17 Pro). Y en el caso de los Mac, Apple Intelligence se activa en los modelos que usan procesador M1 hacia adelante. La siguiente imagen de Apple muestra, con más detalle, qué modelos de sus dispositivos pueden usar Apple Intelligence:

Si su equipo no está en este grupo, no podrá usar Apple Intelligence, ya que esa IA tiene unas exigencias de hardware muy superiores, en parte por una razón de diseño: la IA de Apple procesa la mayoría de las tareas y consultas localmente, es decir, usando el procesador del propio dispositivo, lo cual es mejor en términos de privacidad que resolverlas en la nube (como sucede con las otras IA generativas del mercado).

Así que, si desde hace un tiempo sentía que necesitaba actualizar su equipo Apple, pero estaba aplazando la decisión, la llegada de Apple Intelligence le da una muy buena razón para hacerlo, ya que esa IA se suma al otro gran salto tecnológico que dieron los equipos de Apple en los últimos años: su rendimiento se disparó, a unos niveles notables, desde que se movieron a los procesadores de Apple.

Ahora bien, si usted ya tiene un iPhone, un iPad o un Mac con capacidad de usar Apple Intelligence, luego de actualizarse a los nuevos sistemas operativos debería ver una nueva sección llamada ‘Apple Intelligence y Siri’ en la app Configuración de su equipo. Allí puede, además, activarla, en caso de que no lo esté. Cuando se activa por primera vez, el sistema tarda varios minutos descargando los modelos de esa IA que se van a ejecutar en el dispositivo.

Llevo unos pocos días probando Apple Intelligence en tres dispositivos (un iPhone 15 Pro, un iPad Pro con chip M2 y un Mac Studio), pero ya tengo una idea de su esencia. A continuación le cuento cuáles son las 10 funciones que más me gustaron, y le hablo de la gran ausencia: un Siri ‘más inteligente’, una mejora muy esperada que ya se sabe que llegará en el 2026.

1. La IA pule lo que usted escribe

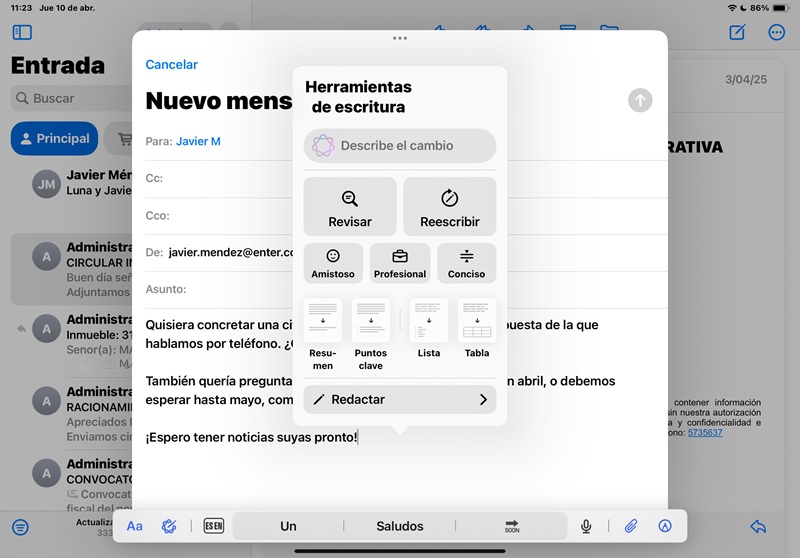

Apple Intelligence tiene herramientas de escritura que ayudan a pulir los textos que uno escribe para diferentes lugares: por ejemplo, los correos electrónicos, los posts que está redactando para sus redes sociales, artículos para un blog, etc.

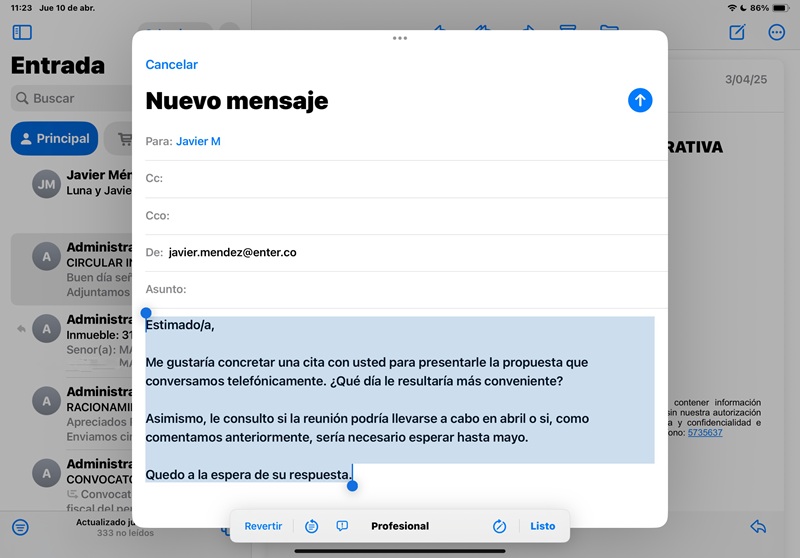

Esas herramientas de IA están disponibles en las aplicaciones que uno emplea para escribir. Por ejemplo, puede acceder a ellas cuando usa la app Notas o la aplicación de Correo, a través de un nuevo ícono (el que en la siguiente imagen se ve en la barra inferior, al lado derecho de la Aa) o mediante un menú que se despliega al seleccionar un texto. Al escribir un texto en Notas, por ejemplo, puedo seleccionar el texto y eso me muestra un menú desplegable con varias opciones, entre ellas ‘Herramientas de escritura’.

Al escoger esa opción, el dispositivo muestra un cuadro en donde uno puede describir el cambio que quiere hacer en el texto (por ejemplo, “quiero que el texto sea más conciso” o “quiero que diga lo mismo con menos palabras”), o también se pueden usar las herramientas predeterminadas, como ‘Revisar’, ‘Reescribir’, ‘Amistoso’ (lo reescribe con un tono más informal), ‘Profesional’, etc. Uno puede dejar los cambios, como en el texto siguiente que se cambió a Profesional, o revertirlos si no le gusta el resultado.

Estas herramientas funcionan muy bien. Algo que me gustó es que cuando le di textos bien redactados y pulidos, no hizo cambios innecesarios, sino que los dejó muy similares. En cambio, cuando alimenté la herramienta con textos vagos, con errores de ortografía y con problemas de puntuación, hizo los cambios que eran pertinentes.

2. Resumir artículos

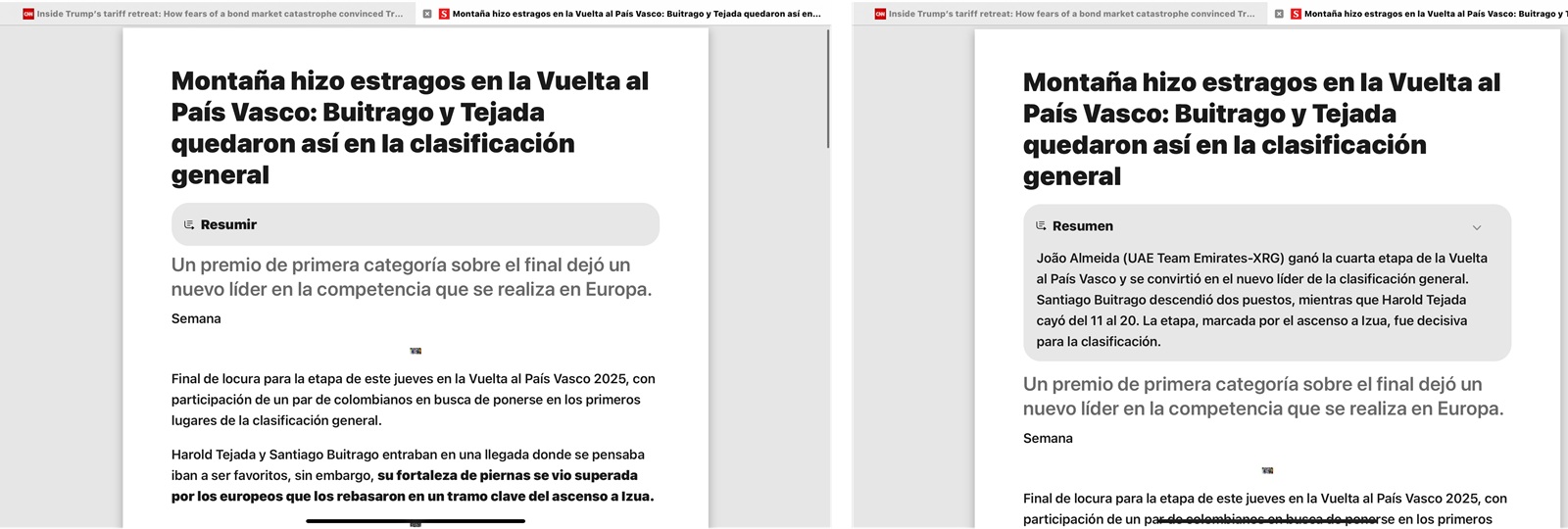

En general prefiero leer completos los textos o artículos que me interesan para cosas de trabajo, sin importar cuán extensos sean, porque no quiero correr el riesgo de que una IA deje por fuera puntos de vista o datos que para mí son muy relevantes. Pero hay muchos artículos con los que me topo en el día a día que ahora le delego a Apple Intelligence para que me los resuma, como algunas noticias del día, especialmente en los artículos que a veces dejan lo importante para el final y que llenan los primeros párrafos con información de contexto, algo que es muy común ahora.

Si uno está leyendo un artículo en Safari, puede usar esa opción tocando el ícono de la parte izquierda de la barra de direcciones del navegador y luego seleccionando ‘Mostrar lector’. En esa vista de lector ahora aparece una banda gris debajo del título que dice ‘Resumir’. Basta tocar allí y se obtiene un resumen del artículo.

3. Creación de imágenes

Esta función seguramente es la que más le va a quitar tiempo al comienzo, al menos mientras ‘calma la fiebre’, como me pasó a mí. Apple Intelligence incluye una app llamada Image Playground que es particularmente divertida, ya que permite crear imágenes tipo animación o ilustración, con base en las instrucciones que uno le da y partiendo de una foto de una persona. Así, uno puede crear versiones ‘caricaturizadas’ de fotos suyas o de cualquiera de sus amigos o familiares.

Lo que más me sorprendió es lo parecidas que quedan algunas de esas versiones caricaturizadas de la persona real. No siempre sucede; hay personas con las que el parecido no es tan evidente, pero esas fueron la excepción. En general, la inteligencia artificial de Image Playground es muy buena para captar las particularidades de los rostros de la gente. Algo más: no solo es una IA generativa, sino también ‘generosa’, y por eso uno siempre aparece más joven de lo que en realidad es.

Después de escoger la foto con la que uno quiere trabajar, uno puede agregar instrucciones específicas (por ejemplo, “vista como médico a esa persona y póngale un estetoscopio”), y además puede seleccionar los fondos y accesorios que la app sugiere (sombreros, escenarios de playa o montaña), etc.

La app va jugando con esas peticiones y elementos y en segundos comienza a mostrar propuestas de imágenes que incorporan lo que uno pidió. Lo mejor es que la IA no solo le muestra una opción, sino que va creando más y más con el paso de los segundos, las cuales uno puede ver desplazándose hacia la derecha.

Al final uno escoge la imagen que quiere y la puede mandar por WhatsApp o correo, por ejemplo.

4. Crear ‘genmojis’

Las herramientas de generación de imágenes de Apple Intelligence también sirven para crear emojis producidos mediante IA, algo que Apple llama genmojis.

En la app de SMS, al tocar el ícono de + a la izquierda de la casilla de mensajes, aparece un menú que ahora incluye la opción ‘Genmoji’. Al seleccionarlo, se ve una casilla en la que uno puede describir el genmoji que quiere crear (por ejemplo, “un burro escribiendo en una máquina de escribir”). En un par de segundos la IA comienza a crear una imagen tras otra; uno escoge la que le gusta y esta aparece en la casilla de texto de la app, lista para enviarse.

Ese genmoji, además, queda incluido en la lista de emojis de la app, y lo mejor de todo es que también se puede usar en otras apps, como WhatsApp, en donde también aparece de ahí en adelante.

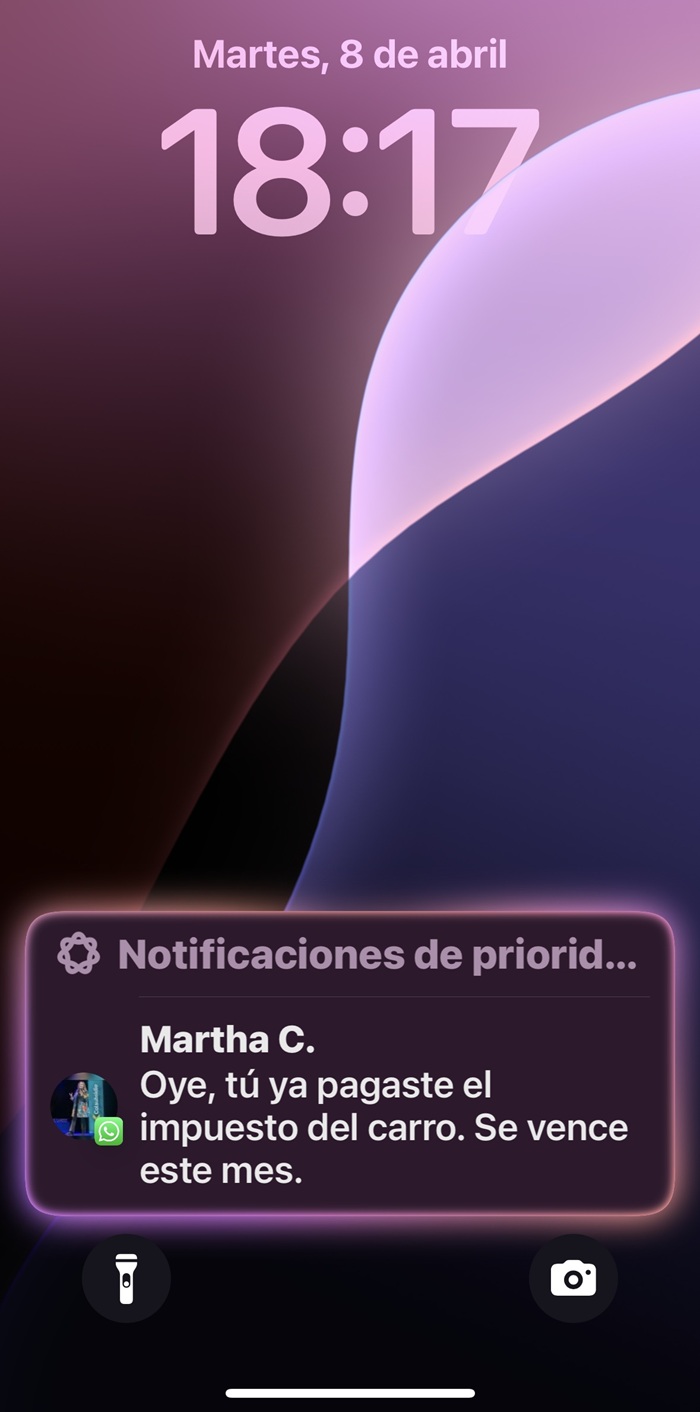

5. Notificaciones con prioridad

Apple Intelligence tiene la capacidad de determinar cuáles de las comunicaciones que usted recibe durante el día son más importantes que otras, para mostrárselas de forma prioritaria en la pantalla. Uno solo debe activar esa función en la sección ‘Notificaciones’ de la app Configuración: allí ahora aparece la sección ‘Apple Intelligence’, en donde se debe activar en ‘Priorizar notificaciones’; además, uno puede definir con qué apps quiere usar esa función (o con todas).

Pensando en la privacidad del usuario, esa función realiza la tarea de analizar el contenido de las comunicación localmente, es decir, se procesa en el dispositivo, y no en la nube.

Solo la he usado unos cuantos días, pero hasta ahora me ha funcionado bien. Por ejemplo, prioriza los mensajes de personas cercanas que tienen cierta urgencia en el tiempo, en vez de mostrarme los incontables mensajes irrelevantes que me llegan en los grupos de WhatsApp a los que pertenezco.

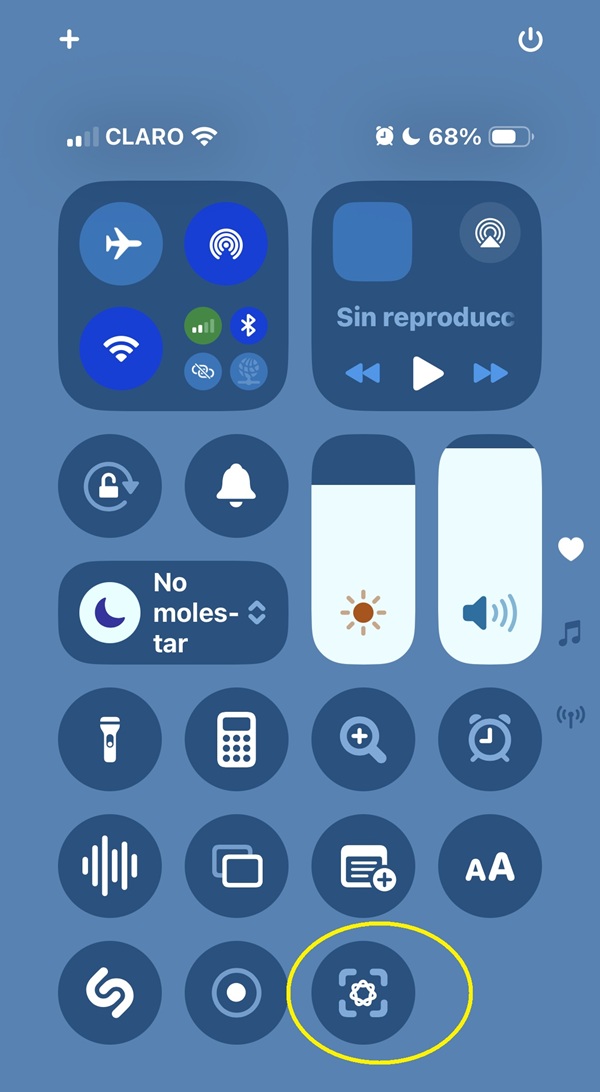

6. Inteligencia Visual

Otra función muy útil es Inteligencia Visual, que usa la cámara del iPhone o el iPad para ayudarle a encontrar información sobre los lugares u objetos que tiene a su alrededor. Esta opción se puede activar desde el nuevo botón de control de cámara de un iPhone 16 o desde un ícono nuevo que ahora aparece en el centro de control:

Al activarse, uno puede apuntar la cámara hacia un objeto y luego seleccionar una de dos opciones: Buscar, que realiza una búsqueda en Google de ese objeto; o Preguntar, que consulta información sobre el objeto en ChatGPT.

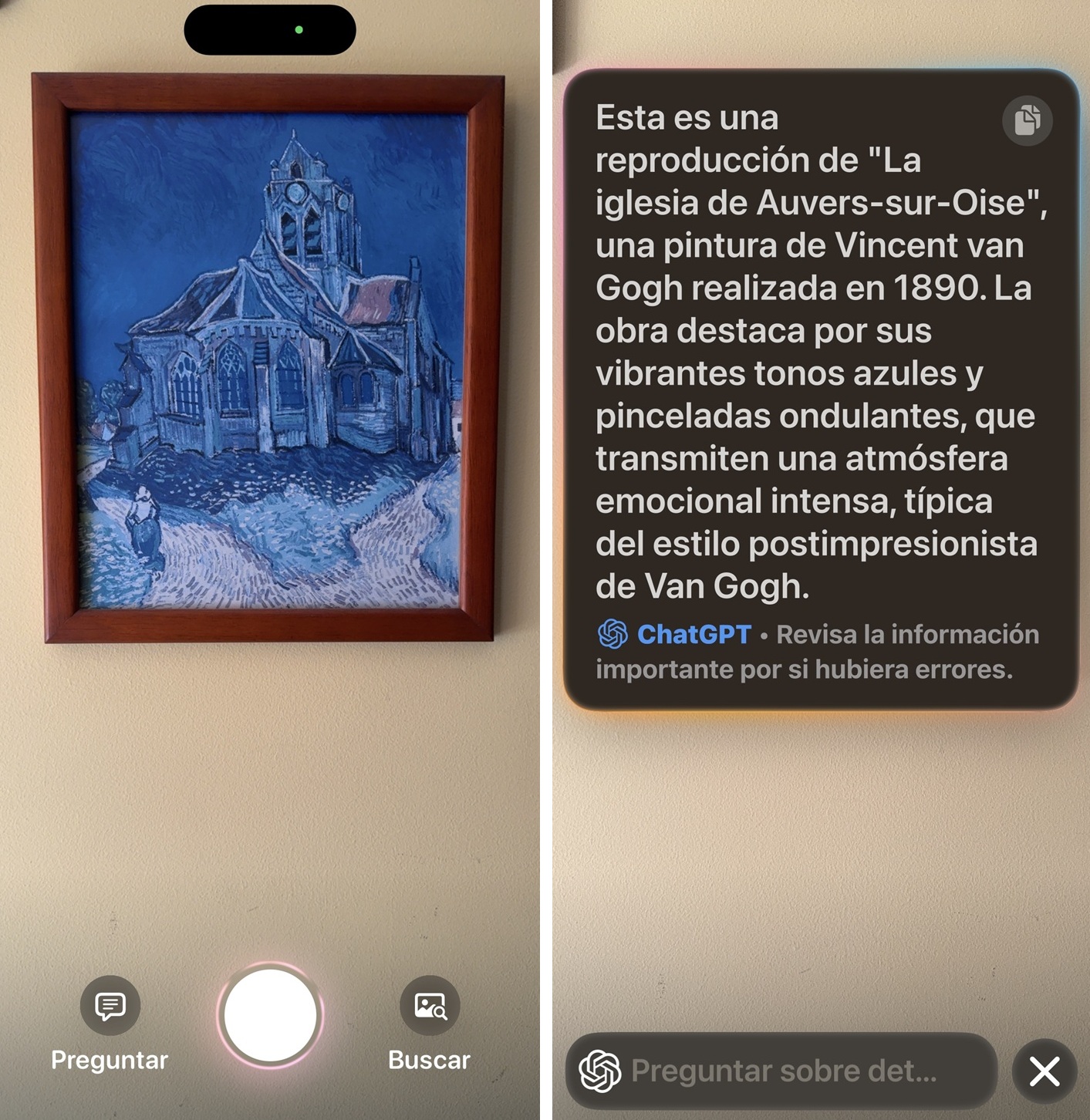

Aquí, por ejemplo, capturé la imagen de un cuadro, y el dispositivo me explicó que se trata de una pintura de Vincent van Gogh; además, ChatGPT me dio algo de información adicional sobre la obra:

Uno también puede usar esta función para obtener información sobre establecimientos comerciales (como sus horarios de atención). Al apuntar la cámara hacia el logo y la fachada de un restaurante en la calle, Inteligencia Visual lo puede conducir al sitio web del sitio, o a su página en alguna red social, para así obtener más información sobre el restaurante.

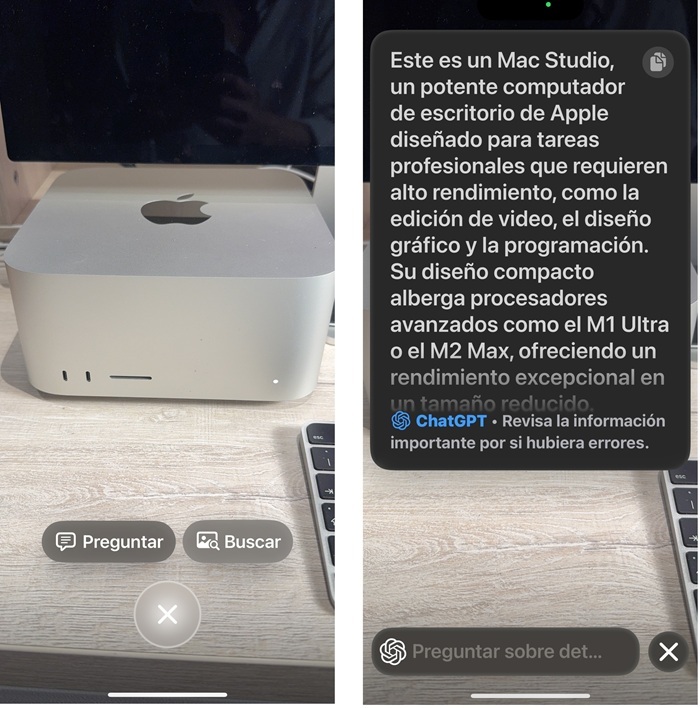

Uno también podría conseguir datos sobre un dispositivo que no identifica a simple vista. Por ejemplo, al tomar esta foto de mi Mac, Inteligencia Visual me dice exactamente qué modelo es (un Mac Studio) y me da información sobre sus características:

7. Integración con ChatGPT

Siri no cambió mucho. La tan esperada renovación de Siri para hacerlo ‘más inteligente’ quedó aplazada. Pero entre tanto, Apple Intelligence ofrece un excelente remplazo: ChatGPT, que ahora puede trabajar en llave con Siri cuando el asistente de Apple no tenga la capacidad para darle una respuesta o resolver una consulta.

Es cierto que uno puede usar la app de ChatGPT en un iPhone o un iPad, pero la ventaja de que ahora se pueda enlazar con Siri es que uno inicia Siri muy fácilmente (con voz, por ejemplo) y este asistente activa ChatGPT cuando así se requiere.

Pero primero le cuento qué pasó con Siri. Una muy esperada mejora de Apple Intelligence, anunciada en el 2024, era un Siri mucho más capaz e ‘inteligente’. Pero el mes pasado, esa compañía admitió que las mejoras que quiere introducir en Siri tomarán más tiempo del que había presupuestado: ahora planea ofrecerlas a partir del 2026, algo que seguramente desilusionó a más de un usuario de dispositivos de Apple, ya que esa era posiblemente la característica más atractiva de Apple Intelligence: un Siri que conoce a su usuario, que tiene contexto sobre sus hábitos y necesidades, y que puede ofrecer opciones muy útiles gracias al poder de la inteligencia generativa (el tipo de IA en el que se basan ChatGPT, Gemini y otras inteligencias artificiales avanzadas).

Es decir, por ahora, no podremos aprovechar un Siri que ofrecerá una ventaja que ninguna otra IA tendrá: como la IA de Apple está integrada en los sistemas operativos de esa empresa, Siri podrá interactuar con las otras aplicaciones de maneras que serán muy convenientes para el usuario. Eso permitirá, por ejemplo, que si un amigo le manda su nueva dirección en un mensaje, usted pueda decirle a Siri que la incluya en su lista de contactos, y la IA automáticamente pondrá esa dirección entre los datos de esa persona. Otro ejemplo que menciona Apple del poder del futuro Siri: si necesita su número de pasaporte, podrá preguntarle a Siri y la IA lo buscará por usted entre las apps de su iPhone (podría estar, por ejemplo, en una foto que usted tomó del documento).

Sin embargo, mientras llega ese nuevo Siri, por ahora uno puede aprovechar el poder de la inteligencia artificial más popular del momento, ChatGPT, que ahora trabaja en llave con Siri. Cuando uno le hace una consulta a Siri, y este asistente no tiene la respuesta, aparece la opción de preguntarle a ChatGPT. Pero uno puede cambiar eso para que Siri no pregunte en cada ocasión si se quiere acudir a ChatGPT; de esa forma, las consultas siempre se irán automáticamente a ChatGPT y la respuesta aparecerá al instante en la pantalla:

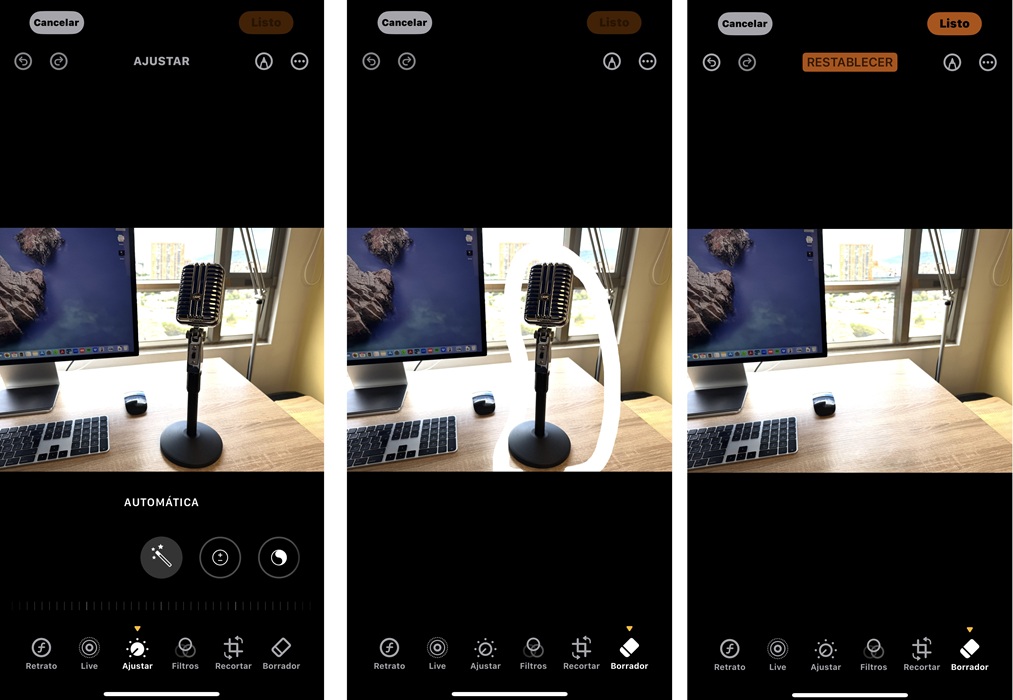

8. Eliminar personas u objetos de las fotos

La aplicación de fotos ahora permite eliminar personas u objetos que uno no quiere ver en las fotos. Para ello, uno abre la imagen en la aplicación de fotos, toca el ícono de editar y luego toca la opción Borrador. Después se traza un círculo con el dedo alrededor de la persona o elemento que se quiere eliminar de la imagen. Inmediatamente la IA borra lo que se pidió y trata de cubrir lo mejor posible lo que había detrás del elemento que desapareció.

Esta característica es muy fácil de usar, pero funciona mejor cuando el fondo detrás de la persona u objeto no es muy complejo; si lo que había detrás es complejo, se podrían ver imperfecciones. En otras ocasiones, como en la foto siguiente, el resultado es perfecto:

9. Transcripción de notas de voz

Como periodista, una nueva función que aprecio bastante es la capacidad de la IA de Apple para crear transcripciones automáticas de las notas de voz. Esto permite eliminar una de las tareas más tediosas de mi trabajo, y estoy seguro de que es igualmente útil para muchas otras profesiones.

Los periodistas solemos grabar las entrevistas usando el teléfono, y en el caso del iPhone empleamos la app Notas de Voz. Pero lo interesante es que ahora no hace falta desgrabar esas entrevistas, una labor demorada y aburrida, porque Apple Intelligence genera automáticamente transcripciones de las notas de voz.

Después de grabar un audio, uno toca los tres puntos que se ven a la derecha de cada grabación y eso despliega un menú en el que se debe escoger la opción ‘Ver transcripción’. Inmediatamente aparece en la pantalla la transcripción del audio:

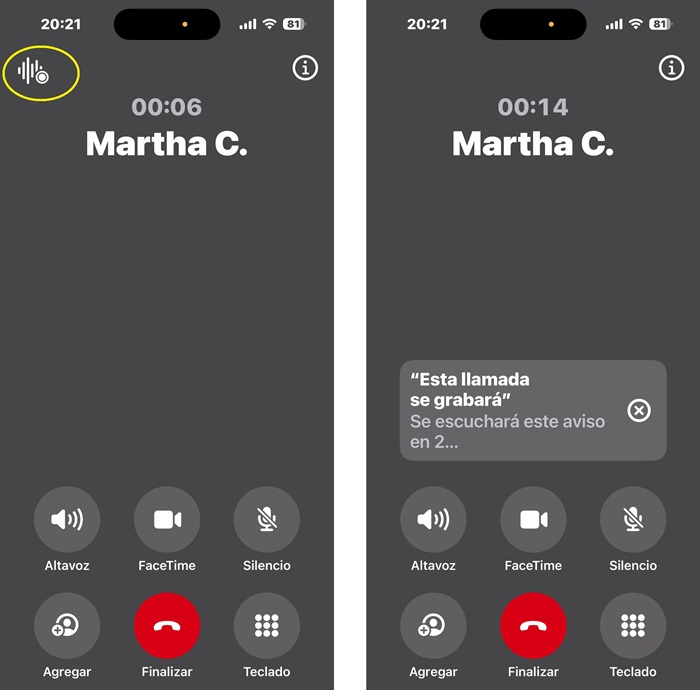

10. Grabación de llamadas telefónicas

Otra nueva capacidad del iPhone que también me pareció fuera de serie es la posibilidad de grabar llamadas telefónicas (algo que también sirve para hacer entrevistas).

Cuando uno hace una llamada desde el iPhone –o cuando la contesta–, ahora aparece en la parte superior izquierda un ícono que, al tocarse, inicia la grabación de la llamada.

Es importante mencionar que al interlocutor le queda completamente claro que la llamada se va a grabar, ya que inmediatamente suenan los pitidos de una especie de conteo regresivo y a los tres segundos se escucha un mensaje de voz que dice: “Esta llamada se grabará”.

Cuando la llamada termina, aparece una notificación de la app de teléfono. Al tocarla se puede escuchar la grabación. Todas las llamadas grabadas quedan almacenadas en la app Notas, y uno puede ponerles un nombre para identificarlas con facilidad.